长短时记忆网络 LSTM

2026/1/30约 740 字大约 2 分钟

长短时记忆网络 LSTM

Long Short-Term Memory(LSTM)是一种门控循环神经网络(Gated RNN),由 Hochreiter & Schmidhuber 提出,用于解决普通 RNN 在处理长序列依赖时的梯度消失 / 梯度爆炸问题。

核心思想:

通过显式的记忆单元(cell state)和门控机制,控制信息的写入、保留与输出。

LSTM 相比普通 RNN 的改进点

普通 RNN:

- 隐状态既承担记忆又承担输出表达

- 多步连乘导致梯度指数级衰减或爆炸

LSTM:

- 引入独立的记忆状态

- 通过加法路径而非纯乘法传播长期信息

- 使用门控结构进行信息选择

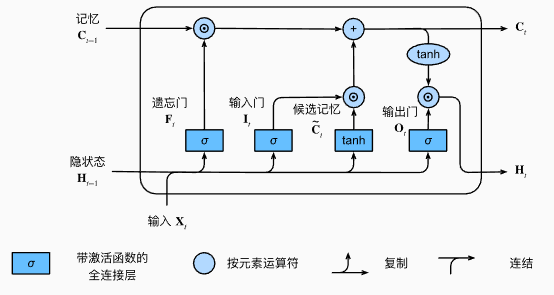

结构组成

- 记忆元(Cell State):,负责长期信息存储

- 隐状态(Hidden State):,对外输出、短期表达

- 三个门控单元

- 遗忘门(Forget Gate)

- 输入门(Input Gate)

- 输出门(Output Gate)

相关信息

- Sigmoid 输出范围:

- Tanh 输出范围:

前向传播流程(Forward Pass)

(1)遗忘门 Forget Gate

决定历史记忆 中哪些需要被保留

- :长期记忆几乎无衰减

- :对应维度的历史信息被清空

(2)输入门 Input Gate

决定当前输入信息写入多少

(3)候选记忆生成

- :当前时刻可写入的候选记忆

(4)更新记忆状态(核心公式)

- 第一项:保留历史信息

- 第二项:写入当前信息

梯度视角:

(5)输出门 Output Gate

决定当前记忆中哪些信息对外可见

- :内部长期记忆

- :对外输出的隐状态

信息流动视角

- :沿时间维度传播(长期记忆)

- :沿网络层级传播(短期表达)

- 门控机制调节二者的交互强度

参数维度说明

设:

- 输入维度:

- 隐状态维度:

则:

LSTM 的特点

优点

- 能有效建模长期依赖

- 梯度传播稳定

- 记忆与输出适度分离

缺点

- 参数量大

- 计算开销高

- 结构相对复杂

LSTM 与 GRU 对比

| 对比项 | LSTM | GRU |

|---|---|---|

| 门数量 | 3 | 2 |

| 独立记忆单元 | 有 | 无 |

| 参数量 | 大 | 较小 |

| 表达能力 | 强 | 略弱 |

常见应用

- 语言模型、机器翻译

- 语音识别

- 时间序列预测

- 生物序列建模

总结

LSTM 通过门控机制与加法记忆通道,使梯度能够在时间维度上稳定传播,从而有效建模长程依赖。